问题描述

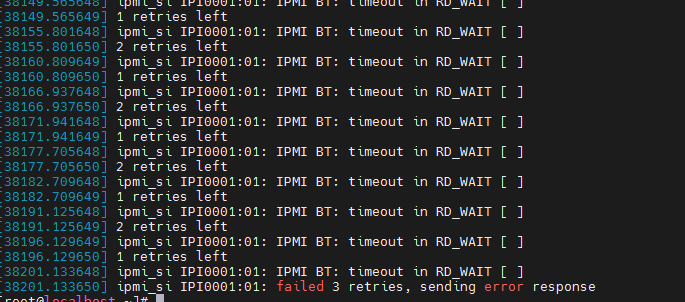

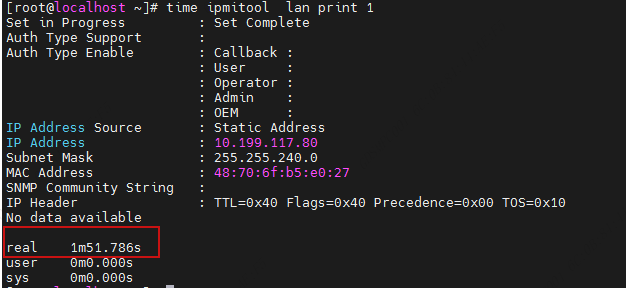

带内执行ipmitool lan print 1命令卡顿,同时os内报IPMI BT:timeout in RD_WAIT

其它:

1、带内执行其它命令不会卡顿,如ipmitool fru等;

2、带外执行这个命令不会卡顿;

3、实际是ipmitool lan print 1中的(ipmitool raw 0xc 0x2 01 0 0 0等)卡顿;

环境信息

-

操作系统:[如 Ubuntu 24.04]

-

软件版本:OpenUBMC2512

重现步骤

-

执行DC cycle测试;

-

DC测试完后,发现执行带内执行ipmitool lan print 1命令卡顿;

期望结果

带内执行ipmitool lan print 1命令不卡顿,无bt相关的timeout

实际结果

1、带内执行ipmitool lan print 1命令卡顿,同时os内报IPMI BT:timeout in RD_WAIT

2、BMC app.log日志中有相关unknown_service WARNING: btc.lua(118): btc[1] request process timeout

尝试过的解决方案

BMC重启后,现象消失