wangdong

2026 年5 月 8 日 05:45

1

// 此模板仅供参考,如果不适用可以修改

已创建endpoint成功,通过接口pcall(endpoint.Request, endpoint, context, request_data_bin,0, {}, {})发送信息(MCTP over pcie),发现经常出现kepler.mctpd.MctpRequestTimeout: The Mctp request timeout.MCTP请求超时的问题。这该如何解决

操作系统:[如 Ubuntu 24.04]

软件版本:[如 OpenUBMC2509]

硬件配置:[如 CPU、内存等]

[第一步]

[第二步]

[第三步]

调用接口不出现mctp请求超时错误

[实际发生了什么,包含错误信息]

[列出您已经尝试过的解决方案及结果]

[详细总结您对此问题的分析结论]

答案内容由AI生成,仅供参考:

MCTP over PCIe 请求超时问题本质是通信链路或响应机制不稳定的体现 ,而不仅仅是网络延迟。虽然 mctp::request 的 15 秒超时机制是直接诱因,但根本原因往往在于:

Endpoint 创建过早(BDF 未就绪)

目标设备响应慢或未就绪

协议封装或介质配置错误

最佳实践建议 :

使用 libmgmt_protocol 封装通信流程,结合 tracemctp 工具进行调试,并在应用层实现智能重试策略。

点击此处查看详细分析解答

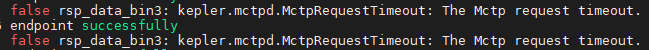

在已成功创建 MCTP over PCIe Endpoint 的情况下,通过调用 pcall(endpoint.Request, endpoint, context, request_data_bin, 0, {}, {}) 发送请求时,频繁出现以下超时错误:

kepler.mctpd.MctpRequestTimeout: The Mctp request timeout.

尽管 Endpoint 创建成功,但实际通信过程中仍发生请求超时,影响正常的数据交互。

根据知识库中的相关信息,MCTP 请求超时的根本原因在于 mctp::request 函数内置了 15 秒的默认超时机制 。当目标设备未在该时间内返回响应时,系统将触发 MctpRequestTimeout 错误。

相关证据:

mctp::request 是一个带有 15秒超时机制 的函数,用于发送 MCTP 请求。超时发生后,Mctp Engine 会记录 Mctp Request Timeout 错误。

日志中显示的 kepler.mctpd.MctpRequestTimeout 正是这一机制触发的具体表现。

目标设备响应延迟或未响应

设备固件处理请求耗时较长,超过 15 秒阈值。

目标设备处于异常状态(如初始化未完成、忙于其他任务)导致无法及时响应。

某些设备(如 NVMe、RAID 卡)在高负载下可能出现延迟。

PCIe 通信链路不稳定

MCTP over PCIe 依赖稳定的 PCIe 链路进行数据传输。

如果 PCIe Card(如 Atlas 300I A2 或其他扩展卡)存在链路训练失败、带宽不足、物理接触不良等问题,可能导致数据包丢失或延迟。

Endpoint 创建时机不当

create_mctp_endpoint_for_others 函数在创建非 SDI6X 设备的 MCTP Endpoint 时存在重试逻辑(默认最多重试 max_retry 次,每次间隔 1 秒)。若在 PCIe 设备 BDF 信息尚未就绪时尝试创建 Endpoint,虽能“成功”创建对象,但实际通信路径并未建立。

dengrenhao 提出的问题:PCIE BDF 信息获取时机可靠性问题 ,可能导致名义上 Endpoint 创建成功,实则不可用。

MCTP 协议配置错误

MCTP over PCIe 使用特定的 message_type(如 NCSI: 0x02, NVMe: 0x04),需与目标设备协商一致。

若 request_data_bin 中封装的命令参数或 context 不正确,设备可能忽略请求或返回错误。

libmgmt_protocol 封装请求,避免手动构造协议错误。

-- 确保 BDF 已就绪后再创建 Endpoint

if not self:is_bdf_ready() then

register_callback_on_bdf_ready(function()

create_mctp_endpoint_for_others(self)

end)

else

create_mctp_endpoint_for_others(self)

end

在 create_mctp_endpoint_for_others 成功后,不应立即发起请求 ,应先通过探测命令验证连通性。

启用 mctpd 的报文跟踪功能,查看请求是否真正发出及是否收到响应。

# 使用新增的调测命令跟踪报文

tracemctp --ObjectName <Endpoint名称>

可输出完整的发送/接收报文数据。

判断是 请求未发出 、无响应返回 还是 响应格式错误 。

来源:《【已评审】Endpoint新增调试时打印报文功能》

目前 mctp::request 的超时固定为 15 秒,位于 libraries/mctp/mctp.cpp 中。

在应用层增加重试机制 :

local max_retries = 3

for i = 1, max_retries do

local ok, rsp = pcall(endpoint.Request, endpoint, context, request_data_bin, 0, {}, {})

if ok and rsp then

break

else

sleep(1000) -- 间隔重试

end

end

与开发团队沟通评估是否可配置超时时间 :

提议将 mctp::request 的超时时间设为可配置参数。

确保 Endpoint 配置的 MediumType 正确反映物理介质类型(如 FiberOptic、Copper 或 SMBus)。

{

"MediumType": "FiberOptic"

}

若配置错误,可能导致底层传输层(如 mctp_lib)行为异常。

特别是混合使用 PCIe 和 SMBus 的场景(如 Hi182x 网卡),需明确区分通信路径。

步骤

操作

目的

1

确认 PCIeCard 的 BDF 地址已就绪再创建 Endpoint

避免创建“假成功”的无效 Endpoint

2

使用 tracemctp 工具开启报文跟踪

查看请求是否发送、是否有响应

3

验证 request_data_bin 和 context 构造是否正确

排除协议封装错误

4

检查目标设备状态是否正常(如 NVMe 是否 ready)

确保对方可响应

5

添加请求重试逻辑,提升容错能力

应对偶发性超时

6

联合日志分析 app.log 中的 kepler.mctpd.MctpRequestTimeout

定位超时频率与上下文

MCTP over PCIe 请求超时问题本质是通信链路或响应机制不稳定的体现 ,而不仅仅是网络延迟。虽然 mctp::request 的 15 秒超时机制是直接诱因,但根本原因往往在于:

Endpoint 创建过早(BDF 未就绪)

目标设备响应慢或未就绪

协议封装或介质配置错误

最佳实践建议 :

使用 libmgmt_protocol 封装通信流程,结合 tracemctp 工具进行调试,并在应用层实现智能重试策略。